大模型风起 汽车安全迎新考题

当被誉为“AI教父”的杰弗里·辛顿(Geoffrey Hinton)获得诺贝尔物理学奖,诺贝尔化学奖也花落身处人工智能公司DeepMind的丹米斯·哈萨比斯(Demis Hassabis)和约翰·乔普(John M. Jumper)时,没有人会再质疑AI给人类社会带来的颠覆性影响。而随着以大模型为代表的人工智能技术逐渐普及,AI换脸等新的安全隐患也层出不穷。不久前,杭州公安便披露了全国首起利用AI换脸大模型突破头部平台人脸认证的案件。一向将“安全”放在首位的汽车行业,如今正积极向“AI定义汽车”时代迈进。如何规避大模型应用所带来的安全风险,成为行业必答题。

汽车大模型从“尝鲜”到“常用”

根据相关数据,截至目前,全球人工智能大模型已有1328个。聚焦汽车产业,不少车企正在加快探索大模型对于汽车智能座舱、智能驾驶等功能的赋能,并试图将大模型应用于汽车研发、设计、营销、运营等众多领域之中。

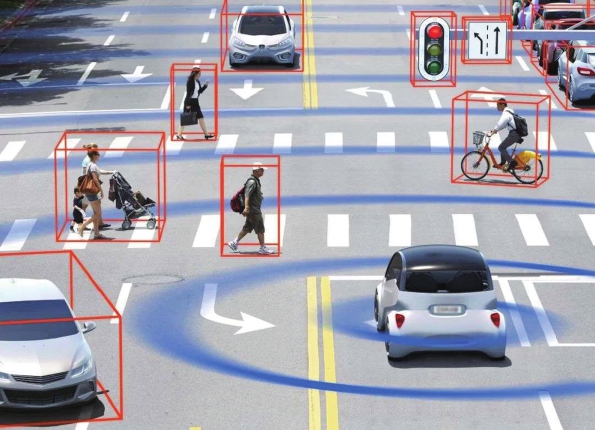

“大模型会加快智驾数据的处理速度,在数据闭环、多场景感知任务识别及多模态任务融合、端到端自动驾驶方面,促进舱驾功能的协同部署。”在中国软件评测中心智能网联汽车产品与系统测评室主任王荣看来,大模型在汽车产业正迅速得到应用,将成为汽车AI化发展的核心。正如其所言,今年以来,百度、字节跳动、商汤科技、科大讯飞等科技企业以及理想汽车、小鹏汽车、蔚来汽车等车企都在加快部署大模型“上车”。

为打造差异化竞争力,智能座舱成为当下汽车企业大模型布局的最佳切入点。借助文心一言大模型,百度推出智能化产品,将百度智能座舱升级为Apollo超级座舱,可实现自动理解、构建,并生成相应场景,调度全车能力,理解用户需求,并主动执行最优全局解决方案。同样是今年4月,蔚来NOMI GPT端云多模态大模型正式上线,赋予了NOMI与用户进行开放式问答的交互能力。理想自研的Mind GPT则具备覆盖111个领域、超1000种以上的专属能力,集用车助手、娱乐助手、出行助手、百科老师于一身。商汤绝影智能座舱大模型产品则已在多家车企量产车型上得到应用,小米SU7的小爱语音助手车载语音场景应用便脱胎于此。

在智能驾驶方面,今年5月,小鹏汽车宣布国内首个端到端大模型量产上车,预计到今年四季度实现“门到门”的智能驾驶;7月,世界人工智能大会上,商汤绝影发布可解释、可交互的自动驾驶大模型DriveAGI,让车辆可以像人一样理解复杂的现实世界,洞察各类交通参与者的行为动机,快速学习各种交通规则,并向用户解释驾驶决策的推理过程;理想则计划推出基于自研大模型和VLM视觉模型的L3级自动驾驶系统。

除了把大模型变为汽车产品力,不少车企也在借助大模型能力提升自身营销、研发、运营等方面的生产力。2023年,华为云盘古大模型首次发布,覆盖了汽车设计、生产、营销、研发等多个业务场景。据了解,盘古汽车大模型现已覆盖汽车业务超20多个L2场景,并已深入到汽车生产、自动驾驶开发、智能座舱开发、智能营销以及产品售后等多个环节。今年4月,腾讯发布汽车行业大模型,实现在汽车研发、生产、营销、服务、企业协同五大核心场景的落地应用。此外,火山引擎也与领克汽车等车企合作,依托豆包大模型打造智能销售AI助手、智慧经营报表等功能,持续释放大模型能力。

“以人工智能为主导的智能化竞争力,已经成为产业和企业新的发展高地和战略支点。”中国电动汽车百人会副理事长兼秘书长张永伟表示,随着AI大模型与汽车的深度融合,汽车产业将进入全面AI化竞争,企业必须利用好AI模型能力,促进汽车智能化水平跃升。

70%安全事故来自远程攻击

普及大模型势在必行,消费者、企业、行业乃至社会发展也确实从中受益,然而新技术的到来必然会给监管提出新的挑战。相关数据显示,今年上半年全球出现的汽车安全事故中,70%均为远程攻击,涉及智能座舱、充电服务、智能控车、自动驾驶等场景,物理攻击仅占5%。如今,大模型的出现无疑给智能网联汽车的安全带来更大挑战。

不久前,中国信息通信研究院发布的《大模型安全研究报告2024》指出,大模型自身存在训练数据安全、算法模型风险、系统平台风险、业务应用风险等方面的安全风险。如大模型插件可能存在缺陷,引发敏感信息泄露、提示词注入、跨插件请求伪造等安全问题;用户与大模型互动也可能无意中泄露自己的隐私或保密信息。

聚焦汽车领域,王荣表示,车用AI模型训练会收集和存储大量包含敏感信息的数据,如驾驶行为、位置信息、乘客信息等,如何确保这些数据在采集、传输、存储等过程中的安全问题也值得关注。另外,攻击者还可通过精心设计的输入数据或植入恶意样本等方式,来欺骗AI模型做出错误决策,影响模型的准确性和安全性。

值得注意的是,如同AI换脸、伪造视频等,大模型在汽车领域的应用也存在AI生成内容带来的安全隐患。王荣称,随着生成式人工智能在智能网联汽车上的推广,文生文、文生图、文生音乐等功能逐渐普及,而生成内容可能涉及隐私、伦理、合规等诸多方面的安全问题,必须对生成内容进行审查和标识管理。

此外,受制于技术发展,大模型的可靠度也值得商榷。王荣表示,AI模型训练依赖高质量数据,数据来源、特征和分布过于单一,或存在错误数据,都会对模型训练数据质量产生影响,进而导致模型推理结果可靠性偏低。《大模型安全实践(2024)》白皮书明确指出,大模型技术仍存在自身缺陷,包括生成内容不可信、能力不可控以及外部安全隐患等问题,由此带来生成“幻觉”问题等风险,影响生成内容的可信度。对于专业性较强的汽车行业而言,大模型对于专业领域知识图谱的学习仍然有限,必须谨慎对待。

不过,不可否认的是,大模型的应用在给汽车安全带来全新挑战的同时,也能够转变为汽车安全的“保护伞”,减少现有部分安全隐患。“生成式AI也能够起到远程维护和监控作用,通过分析车辆传回的数据,制造商能够及时发现并解决潜在问题,提高车辆安全性。”王荣说道。不久前,国内汽车安全公司木卫四便发布汽车安全大模型蝴蝶大模型2.0,可以在数百万辆的汽车异常日志中自动识别黑客攻击和汽车异常状况,帮助车企实时识别汽车安全风险。此外,该安全解决方案还覆盖了智能驾驶、充电桩等领域,并可提供汽车安全情报服务。百度也将大模型运用于汽车安全领域,可对汽车网络环境进行实时监控,对汽车系统漏洞进行智能分析,并结合车辆运行数据对其运行状态进行智能评估。

大模型管理体系待完善

面对大模型这一汽车安全“双刃剑”,如何有效规避风险的同时,挖掘大模型的潜力,需要行业上下共同努力。去年8月,《生成式人工智能服务管理暂行办法》正式施行,提出要根据生成式人工智能服务的风险高低进行分类分级监管,根据生成式人工智能服务适用的不同领域进行行业部门监管。对于汽车产业而言,王荣认为,要提早布局汽车大模型安全管理和评估体系,将大模型应用存在的恶意攻击、隐私泄露、模型泛化等安全风险扼杀于微时。

首先,开展汽车大模型备案。包括备案资料准备、备案信息填报、提交备案申请、备案审核等。大模型获得备案号后还需持续监督模型的合规性,并根据法律法规的变化及时更新备案信息。

其次,制定汽车大模型安全基本要求。组织行业专家制定汽车大模型的安全技术标准,明确数据安全、模型训练、模型使用等方面的安全要求。去年年底,中国信息通信研究院依托人工智能产业联盟安全治理委员会,联合多方开展了“大模型安全风险防范能力”系列评估规范研究和编制工作。目前,《安全大模型能力要求及评估方法》系列规范中的总体框架、基础网络安全两部分已正式发布。聚焦汽车领域,据王荣介绍,中国软件测评中心牵头构建了大模型公共服务平台,针对缺乏公共数据集、测试评价标准、大模型应用验证等行业痛点问题,提供数据汇聚、质量管理、标准规范、应用验证等公共服务。

第三,开展大模型安全评估。建立汽车大模型安全评估体系,包括评估流程、评估方法和评估工具,通过静态和动态分析、模拟攻击、渗透测试、代码审计等方式,评估汽车大模型的安全性能,确保其在实际应用中的安全性和可靠性。